Ausgabe #81 | 22. Juli 2021

Das Gesetz der Blase

Am 26. September 2021 ist es wieder so weit. Ich freue mich jetzt schon darauf. Sie gehört zu den Ritualen von Wahlen ebenso wie Umfragen, Hochrechnungen und Straßeninterviews.

Die „Elefantenrunde“.

Niemand weiß genau, wer wann diesen Begriff prägte. Es gibt sie seit über einem halben Jahrhundert, mit im Grunde immer gleichem Konzept: Am frühen Wahlabend versammelt sich die Runde der Vorsitzenden aller im Bundestag vertretenen Parteien in einem Fernsehstudio und interpretiert die Wahlergebnisse.

Das ist schon allein deshalb immer köstlich anzuhören, weil fast jedes Mal fast alle Parteien die Wahl im Grunde gewonnen haben – glaubt man deren Protagonist*innen. Es gab schon Abende, an denen ein (noch) amtierender Bundeskanzler als Einziger im Raum nicht realisieren wollte, dass seine Zeit abgelaufen war.

Köstlich klingen auch die in Variationen immer wieder dargebrachten Erklärungen, warum denn die reine Prozentzahl so enttäuschend ausfiel, wo doch im Grunde die übergroße Mehrheit der Wählerinnen und Wähler die Position der jeweiligen Partei teilen würde.

Meist seien die angeblich gerade an diesem Tag zu Hause geblieben. Wahlweise wegen zu guten oder zu schlechten Wetters, wegen der falschen Annahme, die Wahl sei ohnehin schon gewonnen oder verloren oder aus anderen, oft überraschend kreativen Gründen.

Eine krachende Wahlniederlage wird zumeist damit begründet, dass man seine – zweifellos klugen und mehrheitsfähigen Positionen – nicht genügend „vermitteln“ konnte.

Faktisch nie hört man den Satz: „Wir haben die Wahl verloren, weil die große Mehrheit der Wähler*innen unsere Ziele nicht teilt.“

Das ist tatsächlich nicht der politischen Rhetorik geschuldet, sondern einer Variante des Phänomens der verzerrten Wahrnehmung.

In der vergangenen Woche sprachen wir über die egocentric bias – kurz gesagt, die Überschätzung der eigenen Bedeutung für Prozesse und Ergebnisse. Wir haben gesehen, dass ein kluger Umgang mit diesem Phänomen zum Beispiel in Beteiligungsprozessen durchaus eine positive Wirkung haben kann.

Heute wollen wir uns eine andere Ausprägung dieser Verzerrung genauer anschauen.

Wir Menschen neigen nicht nur dazu, unsere eigene Rolle (im Positiven wie im Negativen) überzubewerten. Das gilt auch für unsere Sicht auf die Wirklichkeit. Wir glauben in der Regel nicht nur, dass wir Recht haben, wir glauben auch, dass weit mehr Menschen unsere Meinung teilen, als dies der Fall ist.

Verantwortlich dafür sind mehrere Effekte, die zwei wichtigsten sind das Phänomen der Verfügbarkeitsheuristik und die so genannte Bestätigungsverzerrung: die confirmation bias.

Letztere besagt im Grunde, dass wir aus einer Fülle von Informationen tendenziell intensiver jene wahrnehmen, die unsere Meinung bestätigen. Wir bevorzugen also, was uns bestätigt, indem

- passende Informationen besser in Erinnerung bleiben,

- passende Informationen höher gewertet werden als gegensätzliche,

- Informationsquellen für unpassende Informationen gemieden werden.

Das allein verzerrt bereits unsere Wahrnehmung. Dazu kommt, wie wir diese – bereits vorselektierten – Informationen interpretieren.

Hier kommt die Verfügbarkeitsheuristik ins Spiel: Wir bewerten die Wahrscheinlichkeit von Ereignissen je nach ihrer Verfügbarkeit.

Wenn ein Ereignis besonders spektakulär ist, wenn wir davon besonders viel in den Medien lesen, dann halten wir es für besonders häufig.

Und das gilt eben auch für Meinungen. Wir nehmen tendenziell eher zur Kenntnis, was uns bestätigt. Und wir neigen zusätzlich dazu, diese Bestätigungen auch noch für besonders repräsentativ zu halten.

Genau das ist das Geschäftsmodell der Sozialen Medien. Die dortigen Algorithmen checken für uns genau nach diesen Kriterien. Inhalte, die mit unseren Vorlieben korrespondieren, bekommen wir besonders häufig angezeigt, andere werden ausgeblendet. So wirken sie quasi als Katalysator und fügen dieser Verzerrung eine weitere Ebene hinzu:

Wir bekommen ein vorgefiltertes Abbild der Welt präsentiert, selektieren selbst noch einmal und das, was am Ende übrig bleibt, wird dann auch noch verallgemeinert.

Geht es um ganz unbequeme Wahrheiten, so steht am Ende dieser Verzerrungskette dann auch schon mal eine glatte Leugnung der Wirklichkeit. Der Klimawandel ist dann nur ein Fake, Corona eine Erfindung von Bill Gates und Flüchtlinge sind nur hier, um unsere Töchter zu vergewaltigen.

So extrem scheitert die Wirklichkeit nur an wenigen Menschen, aber wir alle sind von den Verzerrungen nicht gefeit. Wir alle unterliegen ihnen – in unterschiedlicher Intensität.

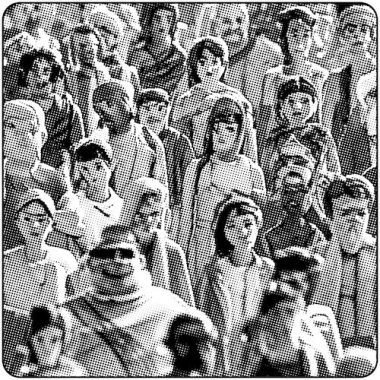

So entsteht am Ende des Tages gesellschaftliche Spaltung, durch Selbstbestätigungsblasen, deren Mitglieder nicht mehr in der Lage sind, mit Anderen wertschätzend zu diskutieren – die es ihnen ja auch nicht leicht machen, weil ihre Blase ihnen eine ganz andere Wirklichkeit vorspiegelt und möglicherweise beide davon überzeugt sind, die Meinung der „schweigenden Mehrheit“ zu teilen.

Schlimm? Sicher. Unlösbar? Keinesfalls. In der kommenden Woche schauen wir uns gemeinsam an, wie wir diese Verzerrungen in Diskursen – und in Beteiligungsprozessen – nicht nur berücksichtigen, sondern tatsächlich austricksen können.

Spannend, auch für die, die Facebookblasen kennen und beachten bzw. die Kommunikation entsprechend einordnen.

Mich interessiert besonders, wie man den eventuell Verzerrten solche Verzerrungen in Beteiligungsprozessen deutlich macht. Andernfalls wird es mir schlecht gelingen, die von mir beobachteten Probleme, die ich nach diesem Artikel als ebensolche Verzerrungen diagnostizieren würde, auszutricksen. Die Verzerrten mag ich nämlich nicht austricksen sondern eher überzeugen.

Vielen Dank für Ihren klarstellenden Hinweis. Ich bin ganz bei Ihnen. Menschen „auszutricksen“ kann funktionieren, fördert aber sicher nicht die Demokratie. Überzeugen ist natürlich im Zeitalter der Blasen auch nicht einfach. Em besten funktioniert es, wenn die Betreffenden „sich selbst davon überzeugen“, dass Demokratie funktioniert – in dem sich echte Beteiligung erfahren, die dann auch in echte Selbstwirksamkeitserfahrung mündet, also darauf orientiert, etwas zu verändern – nicht nur Vorhaben Dritter zu akzeptieren. Denn, wie ich immer wieder betone: Wirkungslose Beteiligung ist wertlose Beteiligung. Wenn sie nichts verändert, verändern sich auch die Beteiligten nicht.